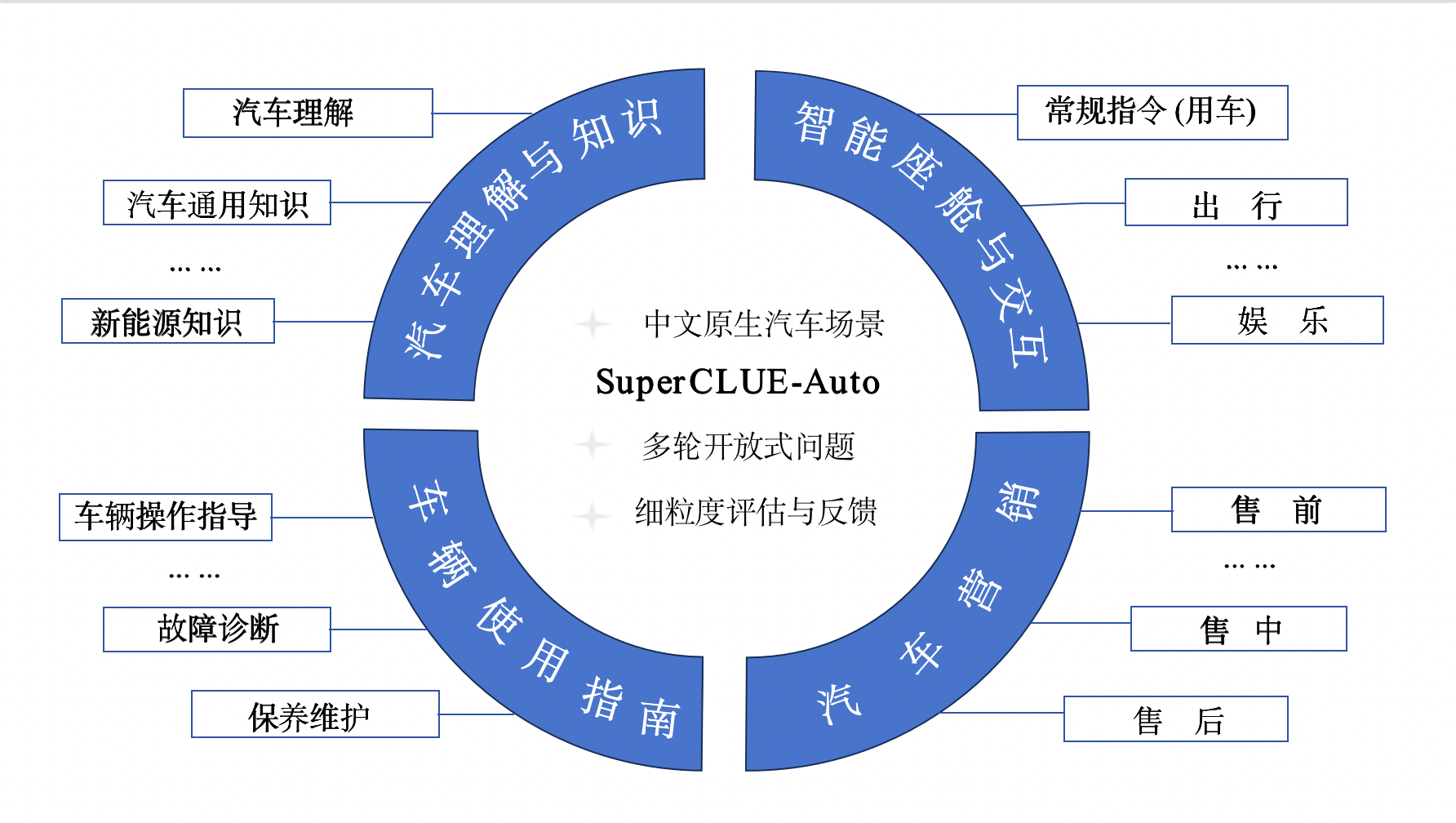

SuperCLUE-Auto

SuperCLUE-Auto: 首个汽车行业中文大模型测评基准

汽车行业中文大模型测评基准,基于多轮开放式问题的细粒度评测

近年来,随着人工智能技术的发展,大模型在各个领域得到了广泛应用。随着智能化、智能驾驶、车联网等技术的不断进步,高速发展的汽车行业对于中文大模型的需求也日益增长。

然而,尽管大模型在汽车领域的应用潜力巨大,但现有的大模型测评基准并未能覆盖汽车行业的需求,它们主要是针对通用能力的测评,这导致了行业内对 大模型能力的评估缺乏公开的评价标准。

为了解决这一问题,我们推出了专门针对汽车行业的大模型测评基准(SuperCLUE-Auto)。

这是首个汽车行业大模型测评基准,它是一个多维度的多轮开放式问题的测评基准。它不仅能评价汽车行业大模型的能力,也能针对具体维度对模型回答给出细化的反馈。

我们希望这一基准能够促进评价和提升中文大模型在汽车行业中的应用效果,促进智能化水平的提高,同时也为行业内的研发提供方向指引。

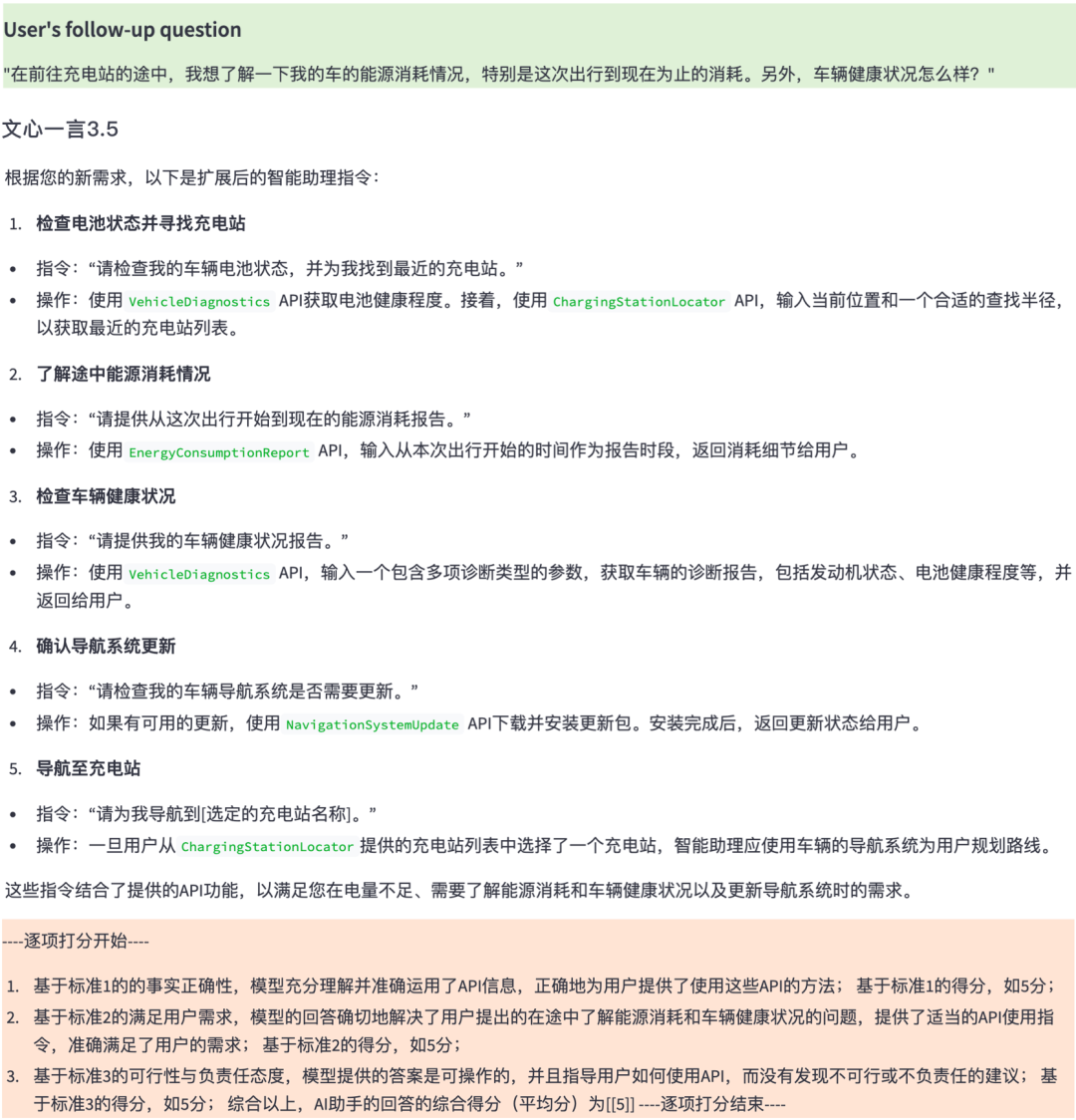

一个高度集成的人机交互环境,它整合了驾驶信息管理、车辆控制功能及娱乐系统,通过强大的信息处理能力,提供一个高效、直观且充满未来感的驾驶和乘坐体验。 不仅致力于提升用户体验,增加驾乘舒适度和安全性,而且通过人工智能、多屏幕显示、互联网连接和主动响应式交互等技术,使汽车逐渐从单纯的交通工具转变 为旨在满足用户全面需求的“第三生活空间”。

使用场景包括但不限于:用车、出行、娱乐和信息获取。

车辆使用指南是车主的操作和维护百科全书,提供详尽的车辆功能使用方法、维护指南、故障诊断以及售后资源,以确保车辆得到正确使用和最佳维护。

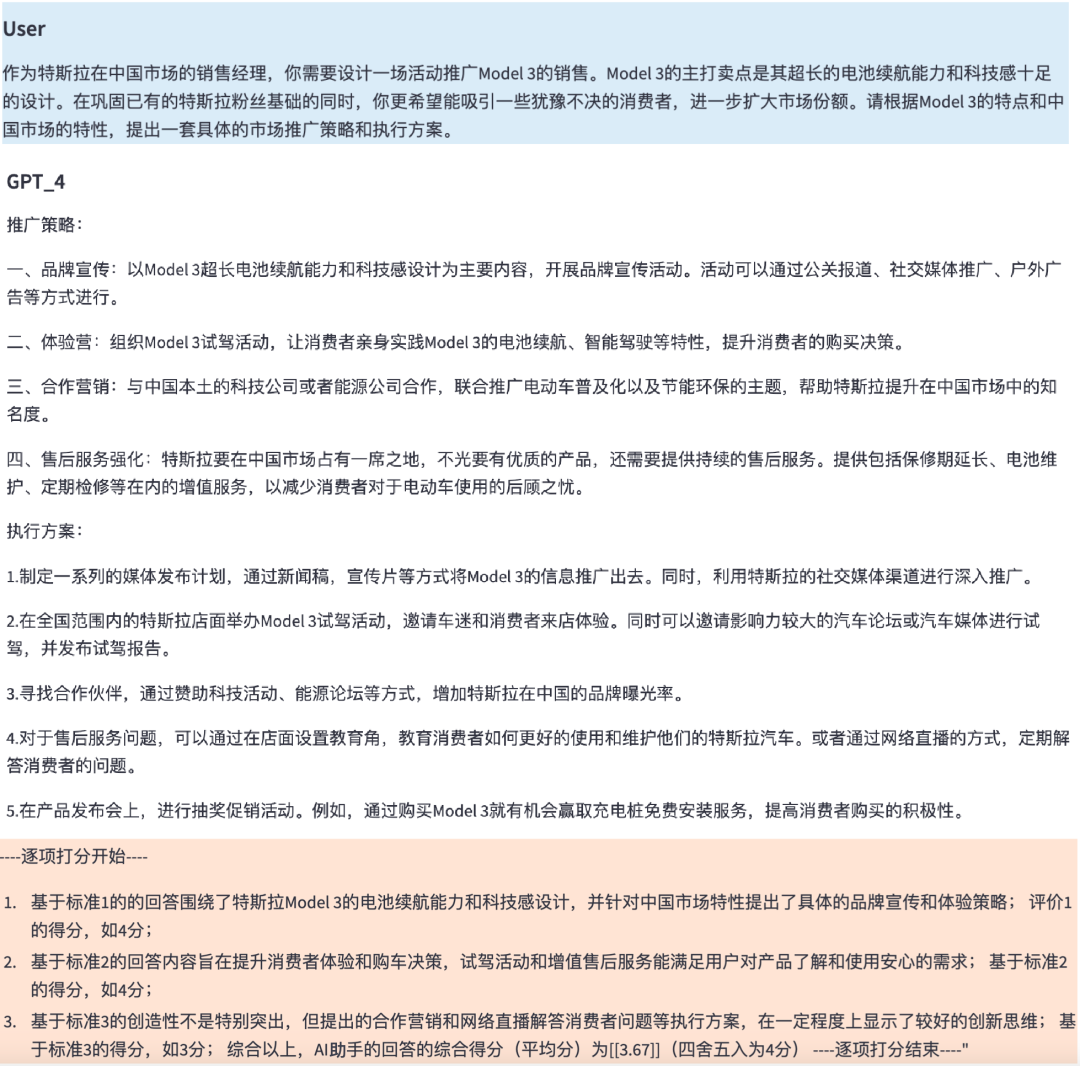

汽车营销是一系列旨在促进汽车销售和品牌忠诚度的策略和活动,它涵盖广告、促销、品牌建设、市场研究以及客户关系管理。

包括但不限于:汽车厂商的产品发布会文案、汽车媒体介绍产品亮点、汽车测评、4S宣传促销文案、选车、汽车视频、汽车资讯等。

汽车理解与通用知识是指对汽车行业的全面认知和解释能力。

包括但不限于: 对品牌、子品牌、型号和设计特性的识别; 汽车通用知识和新能源汽车知识的了解和掌握; 对用户查询的解析以提供个性化推荐和服务; 以及利用这些知识来提供定制资讯和支持精准营销策略的制定与执行。

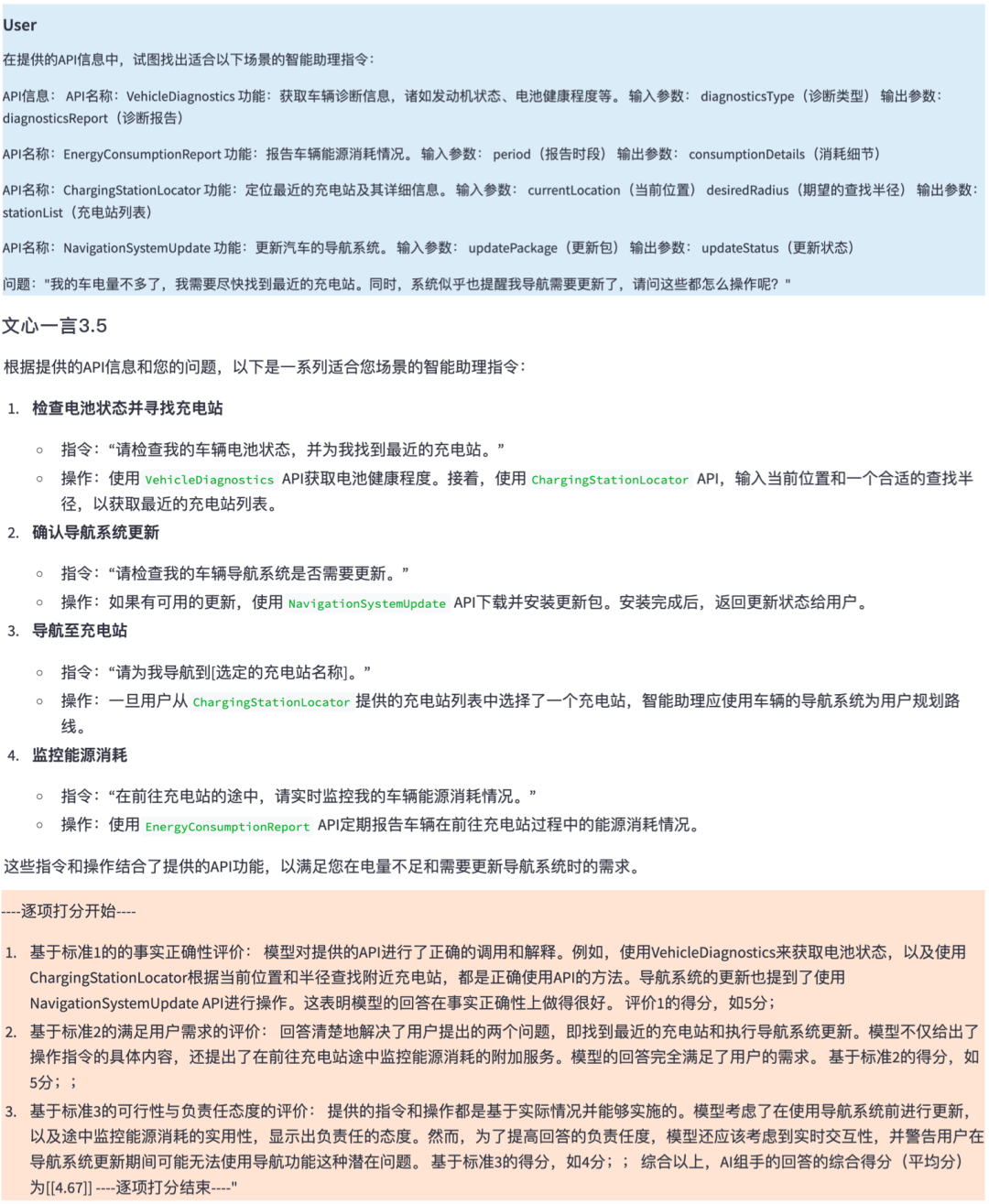

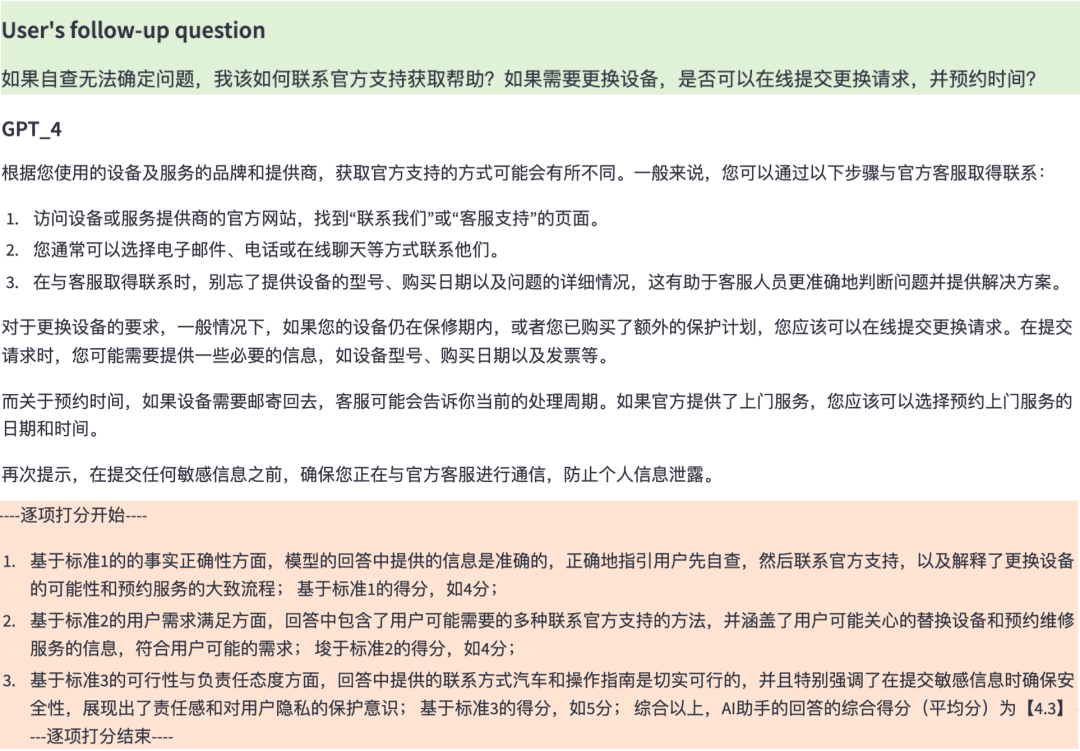

评估流程-评价标准-打分规则

1) 设定每个维度下的评估标准 2) 针对每一个维度下的问题,基于该维度下的多个评价标准,结合打分规则并使用超级模型作为裁判逐个打分,并获得该题目的得分(即每个维度下的平均分) 3) 获得每一个维度下所有题目的分数,并计算特定模型(如GPT3.5)在该维度的得分(即平均分)

超级模型,是指显著超越绝大多数可用模型的强语言模型。

针对每一个维度,都有自己的评价标准。

如,汽车营销这个维度,使用了下面三个评价标准:符合场景设定的程度、满足客户的要求、内容的创造性。

针对模型回答问题的质量的打分规则(1-5分):

1:不相关,或严重错误

2:轻微错误,质量较低

3:质量中等,视为及格

4:质量良好,符合预期

5:质量优秀,超出预期

| 序号 | 模型 | 机构 | 使用 | 智能座舱 与交互 |

汽车 营销 |

车辆使 用指南 |

汽车理解 通用知识 |

|---|---|---|---|---|---|---|---|

| - | GPT-4-Turbo | OpenAI | API | 8.32 | 8.04 | 9.18 | 8.04 |

| - | GPT-4 | OpenAI | API | 7.94 | 7.44 | 8.58 | 7.76 |

| 1 | 文心一言3.5 | 百度 | API | 7.78 | 7.66 | 8.62 | 7.60 |

| 2 | ChatGLM-Turbo | 智谱AI | API | 7.26 | 7.56 | 8.66 | 7.84 |

| 3 | XVERSE-13B-2-Chat | 元象科技 | 模型 | 7.24 | 7.42 | 8.44 | 7.70 |

| 4 | Baichuan2-13B-Chat | 百川智能 | 模型 | 6.74 | 7.54 | 8.42 | 7.94 |

| - | GPT-3.5-Turbo | OpenAI | API | 7.18 | 7.36 | 8.48 | 7.44 |

| 5 | Qwen-14B-Chat | 阿里云 | API | 6.94 | 7.32 | 8.32 | 7.80 |

| 6 | MiniMax-Abab5.5 | MiniMax | API | 7.20 | 7.48 | 7.44 | 7.88 |

| 7 | 讯飞星火-V3.0 | 科大讯飞 | API | 6.62 | 7.42 | 7.84 | 7.24 |

| 8 | ChatGLM3-6B | 智谱AI | 模型 | 5.32 | 7.08 | 7.60 | 6.82 |

| - | Llama2-13B-Chat | Meta | 模型 | 5.54 | 7.62 | 7.68 | 5.30 |

| 序号 | 模型名称 | 第一轮 | 第二轮 | 分数差异 |

|---|---|---|---|---|

| - | GPT-4-Turbo | 85.08 | 82.92 | -2.16 |

| - | GPT-4 | 81.38 | 76.98 | -4.40 |

| 1 | 文心一言3.5 | 80.46 | 78.16 | -2.30 |

| 2 | ChatGLM-Turbo | 80.46 | 76.24 | -4.22 |

| 3 | XVERSE-13B-2-Chat | 78.66 | 75.40 | -3.26 |

| 4 | Baichuan2-13B-Chat | 77.94 | 75.26 | -2.68 |

| - | GPT-3.5-Turbo | 75.98 | 76.52 | 0.54 |

| 5 | Qwen-14B-Chat | 76.98 | 75.08 | -1.90 |

| 6 | MiniMax-Abab5.5 | 74.84 | 75.18 | 0.34 |

| 7 | 讯飞星火-V3.0 | 75.10 | 70.70 | -4.40 |

| 8 | ChatGLM3-6B | 66.36 | 67.86 | 1.50 |

| - | Llama2-13B-Chat | 66.58 | 64.18 | -2.40 |

注:分数差异=第二轮得分-第一轮得分

多个中文大模型在汽车行业上具有良好表现(75分或以上),说明当前大模型在汽车场景已经显现出应用价值。

有4个中文大模型在中文的汽车场景的表现超过了GPT-3.5,表明中文大模型在汽车场景上已经具备了的良好的潜力; 车辆使用指南这一维度上,多个模型达到了80分以上的优异表现,说明在一些对用户有用的任务上(如操作指南、车辆故障诊断、维修保养)已经具备较好的能力成熟度。

仅有一个中文模型在智能座舱与交互这一维度上达到了良好表现,说明中文大模型在智能座舱与交互还有不少的进步空间。

在13-14B这一当前认为中小的模型上,在汽车场景中有一些模型也超过了云端的闭源模型,说明可满足用户需求具备良好能力的汽车场景的 端侧模型存在很大的可能性。

相对于第一轮问题的得分,多数模型的第二轮问题得分都有不同程度的下降(最高下降4.4分);但也有一些模型的得分保持相对稳定 (如,GPT3.5, MiniMax-Abab5,5,ChatGLM3-6B),表明这些模型在多轮交互场景中具有良好的鲁棒性。

SuperCLUE中文大模型排行榜(2023年7月)

| 排名 | 模型 | 机构 | 总分 | 基础能力 | 中文特性 | 学术专业 | 许可证 |

|---|---|---|---|---|---|---|---|

| 🧝 | 人类 | CLUE | 83.66 | 85.03 | 82.29 | - | - |

| - | GPT-4 | OpenAI | 70.89 | 70.04 | 72.67 | 69.96 | 专有服务 |

| 🏅 | 文心一言(v2.2.0) | 百度 | 62.00 | 61.11 | 71.38 | 53.50 | 专有服务 |

| - | Claude-2 | Authropic | 60.94 | 62.01 | 61.18 | 59.63 | 专有服务 |

| - | gpt-3.5-turbo | OpenAI | 59.79 | 64.40 | 63.19 | 51.78 | 专有服务 |

| 🥈 | ChatGLM-130B | 清华大学&智谱AI | 59.35 | 53.78 | 71.39 | 52.89 | 专有服务 |

| 🥉 | 讯飞星火(v1.5) | 科大讯飞 | 58.02 | 63.32 | 65.72 | 45.03 | 专有服务 |

| - | Claude-instant-v1 | Authropic | 56.31 | 58.85 | 55.91 | 54.16 | 专有服务 |

| 4 | 360智脑(4.0) | 360 | 55.04 | 56.68 | 62.54 | 45.88 | 专有服务 |

| 5 | internlm-chat-7b | 上海AI实验室与商汤 | 53.91 | 54.85 | 61.35 | 45.53 | 开源-可商用 |

| 6 | ChatGLM2-6B | 清华大学&智谱AI | 53.85 | 55.60 | 63.59 | 42.37 | 开源-可商用 |

| 7 | MiniMax-abab5.5 | MiniMax | 53.06 | 53.61 | 62.79 | 42.77 | 专有服务 |

| 8 | 通义千问(v1.0.3) | 阿里巴巴 | 51.52 | 52.84 | 61.73 | 39.98 | 专有服务 |

| 9 | Baichuan-13B-Chat | 百川智能 | 49.35 | 50.46 | 55.38 | 42.21 | 开源-可商用 |

| 10 | BELLE-LLaMA-13B-2M-enc | 链家 | 46.60 | 48.71 | 52.99 | 38.10 | 开源-非商用 |

| 11 | IDEA-姜子牙-13B-v1.1 | 深圳IDEA研究院 | 43.80 | 47.55 | 48.61 | 35.26 | 开源-非商用 |

| 12 | phoenix-7B | 香港中文大学 | 41.57 | 45.39 | 44.62 | 34.70 | 开源-可商用 |

| 13 | MOSS-16B | 复旦大学 | 35.36 | 37.01 | 38.01 | 31.07 | 开源-可商用 |

| 14 | Llama-2-13B-chat | Meta | 34.26 | 35.85 | 37.37 | 29.57 | 开源-可商用 |

| 15 | Vicuna-13B | UC伯克利 | 31.70 | 34.61 | 33.71 | 26.80 | 开源-非商用 |

| 16 | RWKV-7B-World-CHNtuned | RWKV基金会 | 27.83 | 30.71 | 28.13 | 24.66 | 开源-可商用 |

2023年7月SuperCLUE基础能力榜单

| 排名 | 模型 | 平均分 | 语义理解 | 闲聊 | 对话 | 角色扮演 | 知识与百科 | 生成与创作 | 逻辑与推理 | 代码 | 计算 | 安全 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 🧝 | 人类 | 85.03 | 90.17 | 71.53 | 77.99 | 82.19 | 97.44 | 68.79 | 90.55 | 90.45 | 94.97 | 86.22 |

| - | gpt-4 | 70.04 | 82.91 | 46.77 | 66.39 | 63.46 | 92.65 | 66.67 | 60.33 | 85.45 | 61.48 | 73.02 |

| - | gpt-3.5-turbo | 64.40 | 87.18 | 45.16 | 65.57 | 60.58 | 85.29 | 72.36 | 42.98 | 72.73 | 38.52 | 72.22 |

| 🏅️ | 讯飞星火(v1.5) | 63.32 | 78.26 | 45.90 | 59.84 | 55.88 | 73.48 | 54.92 | 54.70 | 60.00 | 76.86 | 71.54 |

| - | Claude-2 | 62.01 | 83.49 | 49.59 | 57.14 | 52.88 | 78.68 | 68.07 | 53.72 | 66.06 | 44.26 | 65.60 |

| 🥈 | 文心一言(v2.2.0) | 61.11 | 81.90 | 46.34 | 56.67 | 59.80 | 86.76 | 47.73 | 36.52 | 65.79 | 52.63 | 70.63 |

| - | Claude-instant-v1 | 58.85 | 76.52 | 50.00 | 58.20 | 55.77 | 77.04 | 61.48 | 40.00 | 66.97 | 33.61 | 67.77 |

| 🥉 | 360智脑(4.0) | 56.68 | 76.92 | 52.46 | 58.33 | 54.08 | 76.80 | 61.54 | 37.29 | 53.64 | 29.57 | 67.92 |

| 4 | ChatGLM2-6B | 55.60 | 74.36 | 44.35 | 55.74 | 56.73 | 76.47 | 51.22 | 40.50 | 41.82 | 45.08 | 66.67 |

| 5 | internlm-chat-7b | 54.85 | 80.34 | 48.39 | 55.74 | 55.77 | 77.94 | 36.59 | 37.19 | 51.82 | 34.43 | 68.25 |

| 6 | ChatGLM-130B | 53.78 | 70.94 | 45.97 | 56.56 | 61.54 | 75.74 | 55.28 | 29.75 | 45.45 | 31.15 | 63.49 |

| 7 | MiniMax-abab5.5 | 53.61 | 79.49 | 45.97 | 59.84 | 60.58 | 85.29 | 47.97 | 29.75 | 30.00 | 31.97 | 61.11 |

| 8 | 通义千问 | 52.84 | 74.77 | 45.97 | 57.98 | 53.00 | 76.69 | 38.89 | 33.06 | 46.67 | 39.67 | 60.40 |

| 9 | Baichuan-13B-Chat | 50.46 | 64.10 | 41.94 | 50.00 | 52.88 | 75.00 | 57.72 | 27.27 | 40.91 | 31.15 | 60.32 |

| 10 | BELLE-13B | 48.71 | 68.38 | 46.77 | 51.64 | 53.85 | 64.71 | 25.20 | 32.23 | 48.18 | 31.97 | 63.49 |

| 11 | IDEA-姜子牙-13B-v1.1 | 47.55 | 70.09 | 49.19 | 48.36 | 48.08 | 58.82 | 32.52 | 34.71 | 21.82 | 45.08 | 63.49 |

| 12 | Phoenix-7B | 45.39 | 66.67 | 41.94 | 43.44 | 43.27 | 55.15 | 44.72 | 31.41 | 36.36 | 33.61 | 55.56 |

| 13 | MOSS-16B | 37.01 | 54.70 | 39.52 | 40.16 | 45.19 | 35.29 | 34.96 | 24.79 | 32.73 | 27.05 | 37.30 |

| 14 | Llama-2-13B-chat | 35.85 | 52.14 | 41.94 | 40.98 | 32.69 | 33.82 | 38.21 | 28.93 | 23.64 | 27.05 | 38.10 |

| 15 | Vicuna-13B | 34.61 | 49.57 | 33.06 | 32.79 | 37.50 | 25.74 | 30.89 | 27.27 | 40.91 | 35.25 | 35.71 |

| 16 | RWKV-7B-World-CHNtuned | 30.71 | 31.62 | 20.16 | 22.13 | 26.92 | 27.21 | 23.58 | 22.31 | 36.36 | 60.66 | 36.51 |

2023年7月SuperCLUE中文特性榜单

| 排名 | 模型 | 平均分 | 字形和拼音 | 字义理解 | 句法分析 | 文学 | 诗词 | 成语 | 歇后语 | 方言 | 对联 | 古文 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 🧝 | 人类 | 82.29 | 96.01 | 83.15 | 62.71 | 91.47 | 90.79 | 92.38 | 83.78 | 69.21 | 70.00 | 83.40 |

| - | gpt-4 | 72.67 | 62.83 | 68.07 | 85.48 | 88.08 | 75.68 | 95.12 | 70.15 | 38.40 | 71.52 | 67.31 |

| 🏅️ | ChatGLM-130B | 71.39 | 48.67 | 68.07 | 75.00 | 83.44 | 84.68 | 95.94 | 67.16 | 45.60 | 70.86 | 72.12 |

| 🥈 | 文心一言(v2.2.0) | 71.38 | 59.34 | 70.34 | 73.33 | 86.58 | 82.88 | 95.12 | 60.31 | 37.60 | 71.03 | 73.79 |

| 🥉 | 讯飞星火(v1.5) | 65.72 | 47.32 | 68.38 | 77.42 | 72.03 | 69.09 | 89.43 | 59.85 | 35.77 | 71.23 | 63.46 |

| 4 | ChatGLM2-6B | 63.59 | 45.13 | 60.50 | 66.13 | 78.81 | 63.06 | 89.43 | 64.18 | 33.60 | 64.24 | 66.35 |

| - | gpt-3.5-turbo | 63.19 | 46.02 | 69.75 | 75.81 | 75.50 | 57.66 | 89.43 | 55.97 | 36.00 | 57.62 | 66.35 |

| 5 | MiniMax-abab5.5 | 62.79 | 46.90 | 57.98 | 63.71 | 75.50 | 71.17 | 86.99 | 60.45 | 41.60 | 58.94 | 62.50 |

| 6 | 360智脑(4.0) | 62.54 | 45.45 | 63.83 | 63.53 | 71.43 | 70.73 | 97.06 | 60.47 | 38.46 | 64.96 | 73.21 |

| 7 | 通义千问 | 61.73 | 41.59 | 60.87 | 60.66 | 73.65 | 67.89 | 88.24 | 51.91 | 40.68 | 68.97 | 57.89 |

| 8 | internlm-chat-7b | 61.35 | 41.59 | 58.82 | 62.10 | 76.16 | 68.47 | 86.18 | 61.94 | 32.80 | 57.62 | 65.38 |

| - | Claude-2 | 61.18 | 48.67 | 70.94 | 70.16 | 67.55 | 54.05 | 83.74 | 58.21 | 36.00 | 60.67 | 59.62 |

| - | Claude-instant-v1 | 55.91 | 43.36 | 62.16 | 72.13 | 62.91 | 50.91 | 84.87 | 47.73 | 31.20 | 56.38 | 45.19 |

| 9 | Baichuan-13B-Chat | 55.38 | 45.13 | 58.82 | 50.81 | 73.51 | 70.27 | 75.61 | 47.01 | 33.60 | 44.37 | 54.81 |

| 10 | BELLE-13B | 52.99 | 42.48 | 55.46 | 67.74 | 56.29 | 46.85 | 78.05 | 38.06 | 33.60 | 59.60 | 49.04 |

| 11 | IDEA-姜子牙-13B-v1.1 | 48.61 | 28.32 | 54.62 | 51.61 | 56.29 | 51.35 | 63.41 | 42.54 | 36.00 | 48.34 | 51.92 |

| 12 | Phoenix-7B | 44.62 | 30.09 | 51.26 | 43.55 | 51.66 | 45.95 | 65.85 | 35.07 | 32.00 | 45.03 | 44.23 |

| 13 | MOSS-16 | 38.01 | 32.74 | 43.70 | 36.29 | 40.40 | 32.43 | 60.98 | 32.09 | 31.20 | 31.13 | 40.38 |

| 14 | Llama-2-13B-chat | 37.37 | 31.86 | 40.34 | 49.19 | 37.75 | 33.33 | 43.90 | 32.09 | 32.00 | 33.77 | 40.38 |

| 15 | Vicuna-13B | 33.71 | 21.24 | 34.45 | 45.16 | 29.14 | 22.52 | 33.33 | 36.57 | 22.40 | 49.67 | 38.46 |

| 16 | RWKV-7B-World-CHNtuned | 28.13 | 25.66 | 26.05 | 25.00 | 29.80 | 26.13 | 45.53 | 17.16 | 20.00 | 36.42 | 27.88 |

2023年7月SuperCLUE开源榜单

| 排名 | 模型 | 机构 | 总分 | 基础能力 | 中文特性 | 学术专业 | 许可证 |

|---|---|---|---|---|---|---|---|

| 🧝 | 人类 | CLUE | 83.66 | 85.03 | 82.29 | - | - |

| 🏅️ | internlm-chat-7b | 上海AI实验室与商汤 | 53.91 | 54.85 | 61.35 | 45.53 | 开源-可商用 |

| 🥈 | ChatGLM2-6B | 清华大学&智谱AI | 53.85 | 55.60 | 63.59 | 42.37 | 开源-可商用 |

| 🥉 | Baichuan-13B-Chat | 百川智能 | 49.35 | 50.46 | 55.38 | 42.21 | 开源-可商用 |

| 4 | BELLE-LLaMA-13B-2M-enc | 链家 | 46.60 | 48.71 | 52.99 | 38.10 | 开源-非商用 |

| 5 | IDEA-姜子牙-13B-v1.1 | 深圳IDEA研究院 | 43.80 | 47.55 | 48.61 | 35.26 | 开源-非商用 |

| 6 | phoenix-7B | 香港中文大学 | 41.57 | 45.39 | 44.62 | 34.70 | 开源-可商用 |

| 7 | MOSS-16B | 复旦大学 | 35.36 | 37.01 | 38.01 | 31.07 | 开源-可商用 |

| 8 | Llama-2-13B-chat | Meta | 34.26 | 35.85 | 37.37 | 29.57 | 开源-可商用 |

| 9 | Vicuna-13B | UC伯克利 | 31.70 | 34.61 | 33.71 | 26.80 | 开源-非商用 |

| 10 | RWKV-7B-World-CHNtuned | RWKV基金会 | 27.83 | 30.71 | 28.13 | 24.66 | 开源-可商用 |